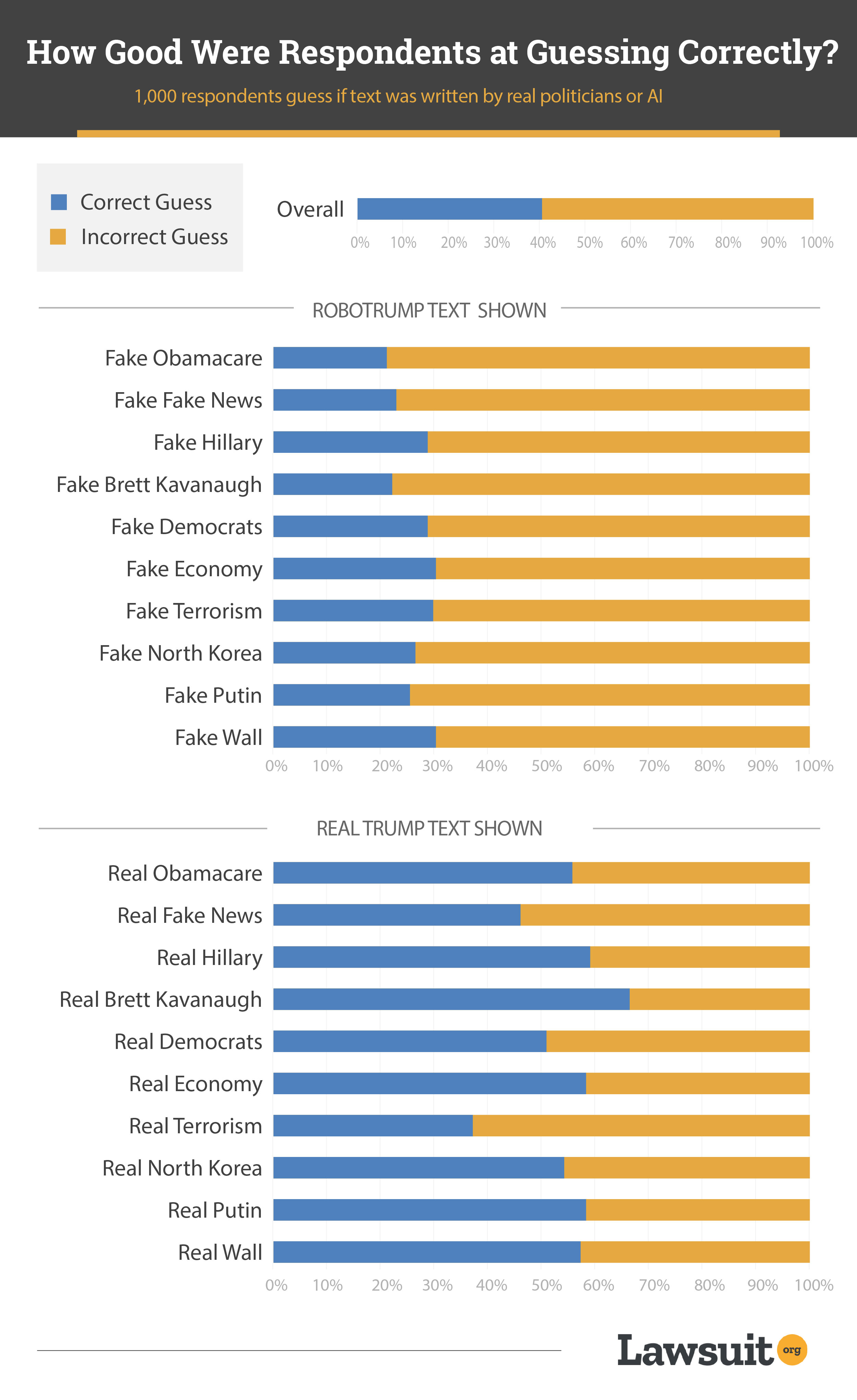

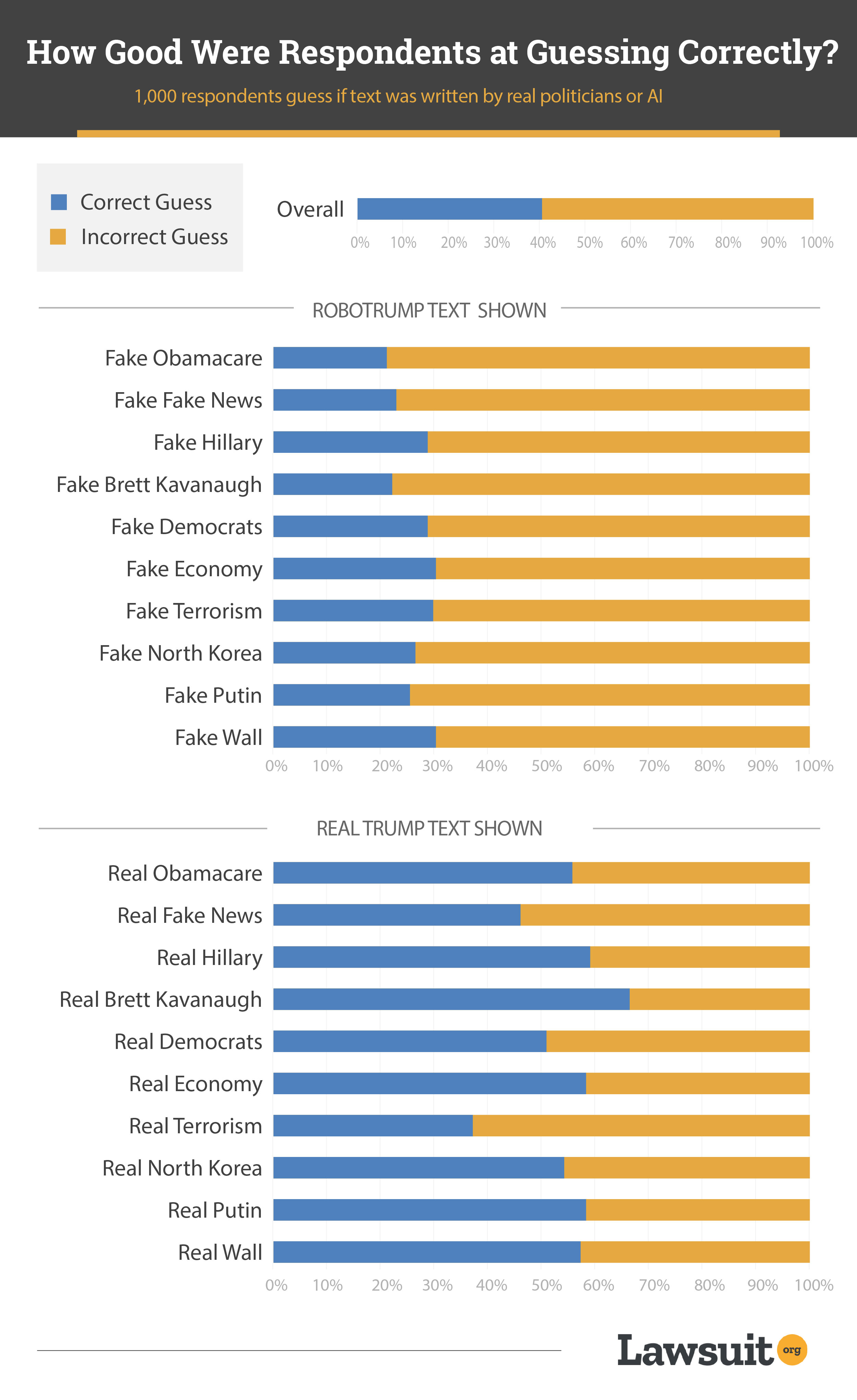

Люди не могут отличить настоящие высказывания Трампа от сгенерированных искусственным интеллектом, выяснили специалисты американского портала о законодательстве Lawsuit.org. Менее половины испытуемых правильно определили, когда демонстрируемые им высказывания принадлежали Трампу, а когда были созданы искусственно.

Эксперты разработали нейросеть RoboTrump, генерирующую текст на основе высказываний президента США Дональда Трампа. Их беспокоило, что подобные алгоритмы могут быть использованы для оказания влияния на президентские выборы 2020 года.

Исследователи предложили 1000 добровольцев прочитать 20 абзацев, посвященных различным политическим темам (экономика, терроризм, мнение по поводу других политиков и т. п.), и определить — это сгенерированный текст или же фрагменты настоящих высказываний Трампа.

Ответы были ошибочными в 60% случаев.

Самих респондентов такие результаты сильно встревожили. 43% из них сообщили, что теперь возможное вмешательство в выборы с помощью ИИ беспокоит их гораздо больше, чем раньше. 12%, однако, отметили, что их опасения поубавились.

Интересно, что консервативно настроенные участники, поддерживающие Трампа, показали заметно худшие результаты, в то время как либеральные респонденты оказались более скептичны. Кроме того, на результаты влиял уровень образования — чем ниже он был, тем более доверчивыми оказывались участники. При этом критичность оценки у наиболее образованных респондентов была несколько ниже, чем у чуть менее образованных — вероятно, они переоценивали свою способность отличать правду от лжи.

Также более доверчивой оказалась молодежь, что удивило исследователей — они полагали, что молодые люди в силу технической подкованности более внимательно отнесутся к результатам.

Говоря о возможных последствиях использования ИИ для влияния на результаты выборов, исследователи отмечают, что тексты такого плана могут применяться для создания фейковых новостей, которые будут распространяться в блогах и соцсетях. Реалистичные речи в стиле Трампа или какого-то другого политика позволят проводить дезинформационные кампании ошеломляющего масштаба, опасаются они.

«Действительно ли ИИ способен создать настолько хороший текст, или Трамп несет такую тарабарщину, что ему так просто подражать?

— задаются вопросом авторы и сами же на него отвечают: — По всей видимости, и то, и другое. Хотя бессвязный стиль речи Трампа действительно упрощает задачу, модели ИИ нового поколения достигли такой степени развития, что способны создавать достаточно реалистичный текст».

Фейковые новости опасны сами по себе, так как имеют более широкий охват аудитории. Как показало исследование специалистов Массачусетского технологического института в 2018 году, в Twitter фейковые новости добираются до первых 1500 адресатов в шесть раз быстрее, чем настоящие. А вероятность ретвита у отдельно взятой фальшивой новости на 70% выше.

lawsuit.org"

class="item-image"

loading="lazy">

lawsuit.org"

class="item-image"

loading="lazy">

Также исследователей интересовал параметр, который они называют «глубиной каскадов», — как далеко новость способна разойтись по цепочкам ретвитов. Если пост опубликовала знаменитость, его прочитал миллион подписчиков, и этим дело ограничилось — это самый неглубокий каскад, какой только может быть. А если запись сделала обычная домохозяйка, пост ретвитнула половина ее друзей, а затем друзья друзей и так далее по цепочке — это совсем другая ситуация.

С точки зрения «глубины» различия между обычными новостями и фейковыми были особенно заметны. Правдивые новости никогда не пробивались дальше глубины 10, и все равно лучшие из фальшивых новостей в десять раз быстрее достигали цепочки в 19 перепостов.

При этом производством фейковых новостей в промышленных масштабах далеко не всегда занимаются политтехнологи, отмечает научный журналист Борислав Козловский в книге «Максимальный репост. Как соцсети заставляют нас верить фейковым новостям».

«В каком-то смысле это самый дешевый контент, которым можно наполнить сайт, зарабатывающий показами самой обычной — не политической, а коммерческой — рекламы, — пишет он. — Чтобы люди кликали по моргающим баннерам «онлайн-казино», «майнинговые фермы под ключ» или «быстрый заработок в интернете», их что-нибудь должно привести на страницу с этими баннерами. Короткие тексты про Клинтон, Трампа, либералов-педофилов и военных, которые вызывают ураганы своими испытаниями секретного оружия, и дешевле в производстве, чем порнография, и безопаснее с точки зрения закона, чем пиратские копии фильмов. Фальшивые новости, в общем, легальны почти всюду — за текст, который просто не соответствует действительности, мало где могут посадить в тюрьму».

Цивилизация

Цивилизация