«Создавайте анимации для лиц на семейных фотографиях с помощью потрясающей технологий. Исследуйте свою семейную историю так, как никогда раньше!» — именно так презентует свой новый сервис генеалогический сайт и социальная сеть MyHeritage. В ней появилась функция, получившая название DeepNostalgia. С ее помощью у пользователя есть возможность «оживить» портрет, заставив человека на фотографии моргать, двигать головой и улыбаться. В результате получается небольшой видеоролик.

Как сообщили в руководстве MyHeritage, они намеренно отказались от добавления голоса и звуков, чтобы «не допустить злоупотреблений, например, создания дипфейков с живыми людьми».

«Эта функция была сделана из ностальгических соображений, чтобы вы могли вернуть любимых предков к жизни», — говорится в разделе вопросов и ответов, посвященных DeepNostalgia.

При этом там же указано, что некоторые пользователи восприняли функцию позитивно, назвав ее «магической», а другим она не понравилась из-за своей «криповости». «Результаты могут быть противоречивыми, но остаться неравнодушными к этой технологии сложно», — заключили в MyHeritage.

Сейчас в Twitter можно найти большое количество постов с хэштегом #MyHeritage, в которых люди делятся своими результатами использования функций DeepNostalgia. Многие загружают в сервис фотографии своих умерших родственников — некоторые из пользователей не застали их в живых, поэтому DeepNostalgia позволяет им получить представление о том, как их прабабушка или прадедушка могли двигаться и улыбаться.

my great grandfather died 20 years before I was born and I've never seen a video of him, so seeing technology work like this absolutely blows my mind! #DeepNostalgia #myheritage Twitter

— Matt Daly (@GenealogyMatt) February 26, 2021

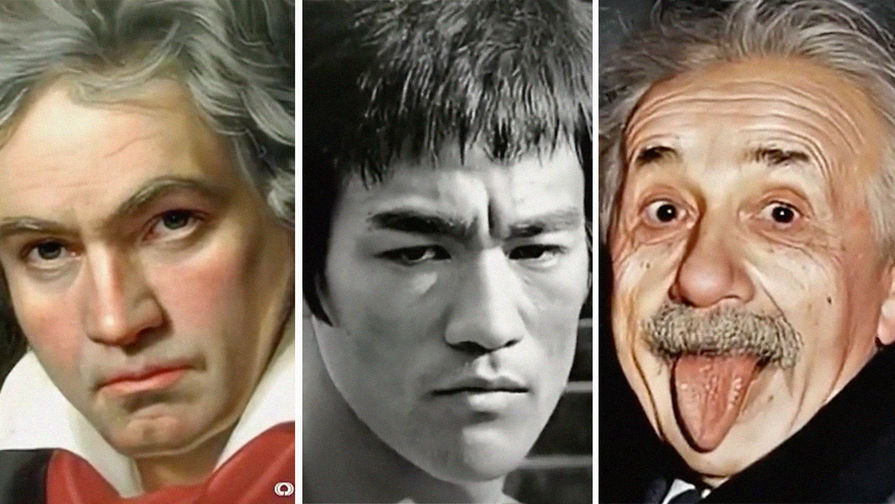

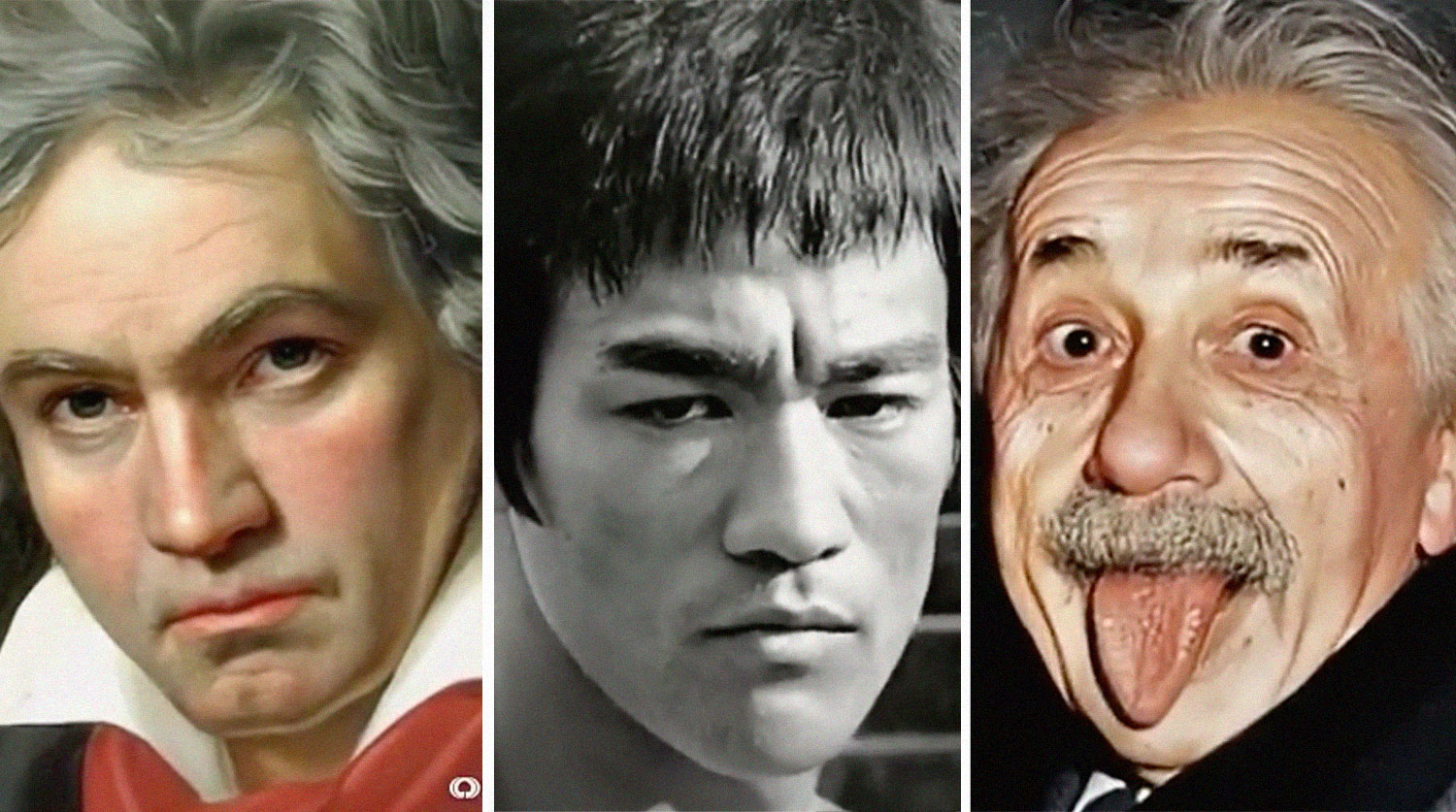

Некоторые пользователи загружают на сайт фотографии умерших знаменитостей. Так, например, был «оживлен» Брюс Ли.

Recently brought Bruce Lee back to life with MyHeritage Deep Nostalgia #BruceLee #MyHeritage Twitter

— MetalGearTech (@MetalGearTech) February 28, 2021

С помощью DeepNostalgia удалось добиться анимации знаменитого портрета Альберта Эйнштейна. Впрочем, нейросети пока еще не настолько продвинуты, чтобы заставить его убрать язык.

#MyHeritage Science

— Atelier Parisgraphe (@parisgraphe) February 28, 2021

A. Einstein Twitter

Кроме того, этот инструмент отлично подходит и для погибших персонажей. Один из юзеров воспользовался им и «вернул к жизни» Лору Палмер из культового сериала «Твин Пикс».

Everyone's using the My Heritage thing to revive dead relatives, but I had to use it to bring back Laura Palmer #twinpeaks #DeepNostalgia #myheritage #laurapalmer @mfrost11 @DAVID_LYNCH Twitter

— Matias KILLERMANN (@dagooh) March 1, 2021

Также DeepNostalgia отлично работает с портретами, которые не являются фотографиями. Вот так, например, мог бы выглядеть Людвиг ван Бетховен.

L. V. Beethoven Twitter

— Atelier Parisgraphe (@parisgraphe) February 28, 2021

А вот так — Мона Лиза.

#DeepNostalgia on the Mona LisaTwitter

— Esther Willemsen (@2tongig) February 27, 2021

Другие пользователи пошли еще дальше и «оживили» статуи.

This thing is too much fun - Early Dynastic statue from Mari at the Louvre #MyHeritage #DeepNostalgia Twitter

— George Heath-Whyte (@GHeathWhyte) February 28, 2021

So I wanted to know how the recent #DeepLearning facial animations services do with busts and decided to give that botched Christiano Ronaldo statue a spin. What ensued can only be summarised as #DeepNostalgia --> #DeeplyDisturbed. Sweet dreams! ;) Twitter

— Jan Smeddinck (@smeddinck) February 27, 2021

Технология, которая лежит в основе Deep Nostalgia, была разработана израильской фирмой D-ID. Для «оживления» портретов умерших используется искусственный интеллект, который «тренируют» на видеороликах с живыми людьми.

«Ненастоящие» ролики, созданные при помощи ИИ на основе уже существующих фото и видео, называют дипфейками.

Это слово появилось из объединения двух понятий — глубокого обучения [deep learning] и подделки [fake]. Также никнейм Deepfakes носил создатель этой технологии — студент Стэндфордского университета Ян Гудфеллоу.

Несмотря на то, что дипфейки в основном носят развлекательный характер, специалисты в сфере искусственного интеллекта предупреждают об опасностях, которые могут появиться при использовании этой технологии. Так, например, реалистично выглядящий, но фейковый ролик можно использовать для дискредитации публичной персоны, заставив ее «говорить» неприемлемые вещи. Кроме того, дипфейки часто используются при создании порнографии — возможности технологии позволяют «приклеить» к телу актрисы буквально любое лицо.

В конце 2020 года британский канал Channel4 показал в эфире свой вариант рождественского послания королевы Елизаветы с плясками на столе и шутками про принца Гарри и его супругу Меган Маркл. Несмотря на то, что видео изначально позиционировалось как пародия, его появление на ТВ вызвало споры касательно применения дипфейков в отношении британского монарха.

Цивилизация

Цивилизация