Больше требований, больше ответственности

Если 2018 год был годом пробуждения, то 2019 год станет годом действий, считает Кэти Бакстер, архитектор этического ИИ компании Salesforce. Речь идет о том, что многие пользователи уже озабочены тем, как используется их личная информация в социальных сетях, например, Facebook, а правозащитники требуют от техкомпаний большей прозрачности в сфере сбора и анализа данных.

Кроме того, нейросети часто выступают в качестве модераторов контента, порой удаляя даже безобидные публикации, что приводит к нарушению прав человека.

В прошлом году в Кремниевой долине произошло несколько громких историй, связанных с нежеланием сотрудников крупных IT-компаний создавать искусственный интеллект, который впоследствии будет использоваться полицией или армией, а значит может косвенно стать причиной ареста или даже смерти. Бакстер полагает, что в этом году работники, создающие ИИ, будут все чаще требовать от руководства объяснений касательно сферы применения своего изобретения и отказываться от разработок, если они будут влиять на мир в негативном ключе.

«Компаниям придется идти на сделку с совестью — вне зависимости от того, покупают они ИИ или его создают — и уверять себя, что все системы работают по справедливости, чтобы избежать заголовков о том, как искусственный интеллект вышел из-под контроля», — считает эксперт.

Расцвет фейков

В 2018 году слово «фейк» фигурировало на страницах прессы практически постоянно — речь шла то о пропагандистских публикациях, предназначенных для введения людей в заблуждение, то о недостоверных новостях, то «отфотошопленных» фотографиях. В этом же году мир всерьез озаботился развитием deep fakes — технологии, которая с помощью искусственного интеллекта может создавать фейковые ролики, практически неотличимые от настоящих, что выводит дезинформацию в интернете на новый качественный уровень.

Deep fakes не зря назвали «фотошопом для видео, только на стероидах». Если сейчас люди в основном развлекаются, используя эту технологию для того, чтобы создавать порноролики «с участием» любимых голливудских звезд, то в будущем эти ролики будут монтироваться для влияния на международную ситуацию.

Фейковое видео, на котором один глава государства нелестно отзывается о другом, запущенное в интернет, мгновенно превратится в информационное оружие, способное даже развязать войну.

В 2019 году сложнее будет отличить реальность от вымысла: нас ждет наплыв не только фальшивых текстов, но и изображения, видео со сценами и аудиозаписи разговоров, которые на самом деле никогда не происходили, подтверждает генеральный директор ABBYY Россия Дмитрий Шушкин. При этом выявить подделку самостоятельно будет уже невозможно, так как для этого потребуются интеллектуальные алгоритмы.

Правда вскроется

Тенденция отслеживать передвижения пользователя, его предпочтения в социальных сетях, а также запросы в поисковых системах, чтобы эффективнее продавать ему рекламу, явно сохранится на ближайшие годы.

«Еще Джордж Оруэлл поселил в нас страх при перед мыслью о тотальной слежке, когда каждый наш шаг фиксируется и анализируется. Однако, изучив последние тенденции в применении искусственного интеллекта, можно с уверенностью заявить: Большой Брат существует — и он работает на Уолл-стрит. В оруэлловской антиутопии система слежения использовалась тоталитарным государством для насаждения идеологии, а в реальности следить за нами хотят корпорации — чтобы успешнее продавать товары и рекламу», — рассказал аналитик компании Zichain Арсений Бессмертных.

Речь идет о так называемых «альтернативных данных» — массивах самой разнообразной информации, обработать которые под силу лишь ИИ. Вопрос о том, нарушает ли это права граждан на неприкосновенность частной жизни, остается открытым.

Индустрия «альтернативных данных» стремительно развивается — по оценкам Greenwich Associates, на приобретение такой информации компании потратят в этом году 300 млн долларов.

Не получится избежать всевидящего ока искусственного интеллекта и компаниям-эмитентам. Так, в Apple этой осенью объявили о том,что больше не будут раскрывать ежеквартальные результаты продаж iPhone. Но удастся ли сохранить эту информацию в тайне, если данные о продажах можно получить, проанализировав массив данных об активациях новых смартфонов? Или, например, отследив количество посетителей в каждом Apple Store на планете? С развитием искусственного интеллекта и ростом популярности «альтернативных данных», все тайное вскоре станет явным.

Всевидящее око

Технологии машинного зрения переживают бум своего развития. Они уже могут контролировать качество готовых деталей двигателя, считать количество леденцов в пачке на кондитерской фабрике или людей на стадионе, находить на медицинском снимке опухоли, рассказывает Дмитрий Шушкин.

Благодаря развитию 3D, машинное зрение уже начали успешно тестировать и в беспилотном транспорте: квадрокоптерах, грузовиках и комбайнах. В то же время, полностью полагаться на визуальный канал машины не могут.

«Например, в снегопад на дорожном полотне не видно разметки, а пока никто не придумал двойную сплошную, которая автоматически растапливает снег. По этой причине в 2019 не стоит ждать массового распространения беспилотных автомобилей – хотя, безусловно, такие машины научатся лучше определять скорость, угол и траекторию движения животных, людей и других автомобилей», — считает эксперт.

Машинное зрение скоро станет привычным и для рядового потребителя. Вы уже используете эти технологии в банке, когда наводите камеру смартфона на документ и оплачиваете счет за квартиру, покупаете билет на поезд или регистрируетесь в каршеринге, показав в приложении свой паспорт или водительское удостоверение. А совсем скоро любой сможет с помощью телефона распознавать здания по их внешнему виду, определять автора картины или бренд рубашки, а затем находить похожие вещи в магазине – вплоть до конкретного фасона и материалов.

ИИ на страже безопасности

Искусственный интеллект уже стал «мейнстримом», присутствуя в «умных» колонках, системе распознавания лиц и других массовых продуктах. Куда менее присутствие ИИ заметно в таких сферах, как логистика, здравоохранения и, что наиболее важно, в информационной безопасности.

Тем не менее, в современной ситуации, если в стратегии по кибербезопасности никак не участвует ИИ, то вероятность хакерского взлома повышается в несколько раз, считает главный технический директор Sophos Джо Леви.

«Если ваша система защищена при помощи искусственного интеллекта, то хакерам останется либо искать более легкую цель, либо разрабатывать более сложные и дорогостоящие инструменты взлома, так что гонка кибервооружений продолжится», — отмечает эксперт.

Вопрос доверия

Искусственный интеллект стал частью нашей повседневности, и с этим уже ничего не поделать. Мы с удовольствием путешествуем самолетами, которые уже давно управляются автопилотом, общаемся с голосовыми помощниками или обновляем плейлист с помощью рекомендательных алгоритмов музыкальных сервисов.

Однако, масштабных проектов в этой сфере по-прежнему мало. Нет правовых стандартов, которые бы регулировали отрасль.

Но самое главное — нет доверия со стороны человека, рассказывает глава представительства Riverbed Technology в России и СНГ Александр Стулов.

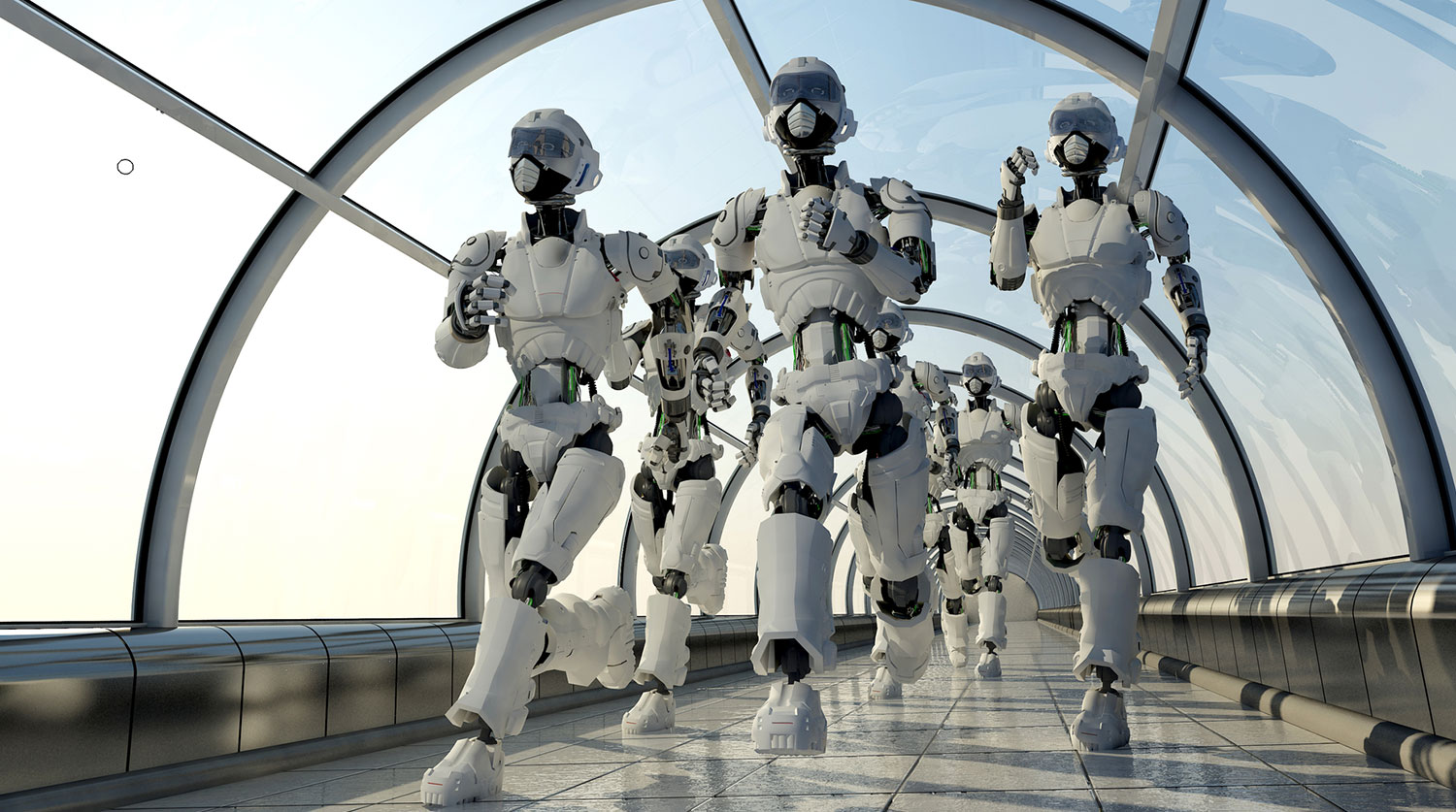

«Нам психологически тяжело согласиться передать машинам контроль над сферами жизни, которые всегда зависели только от нашей воли. Еще больше нас пугает перспектива оказаться слабее собственного изобретения — в перспективе ближайших лет аналитики, начиная с Gartner и заканчивая Всемирным банком, пророчат человечеству массовую безработицу по вине повсеместной автоматизации», — заявил эксперт.

Например, среди профессий из «зоны риска» есть водители такси, общественного и грузового транспорта. Однако, несмотря на шумиху вокруг беспилотного транспорта и старания компаний-визионеров, в ближайшие годы мы не увидим массового внедрения этой технологии — PwC прогнозирует появление беспилотного общественного транспорта в крупных городах только к 2040 г.

Цивилизация

Цивилизация